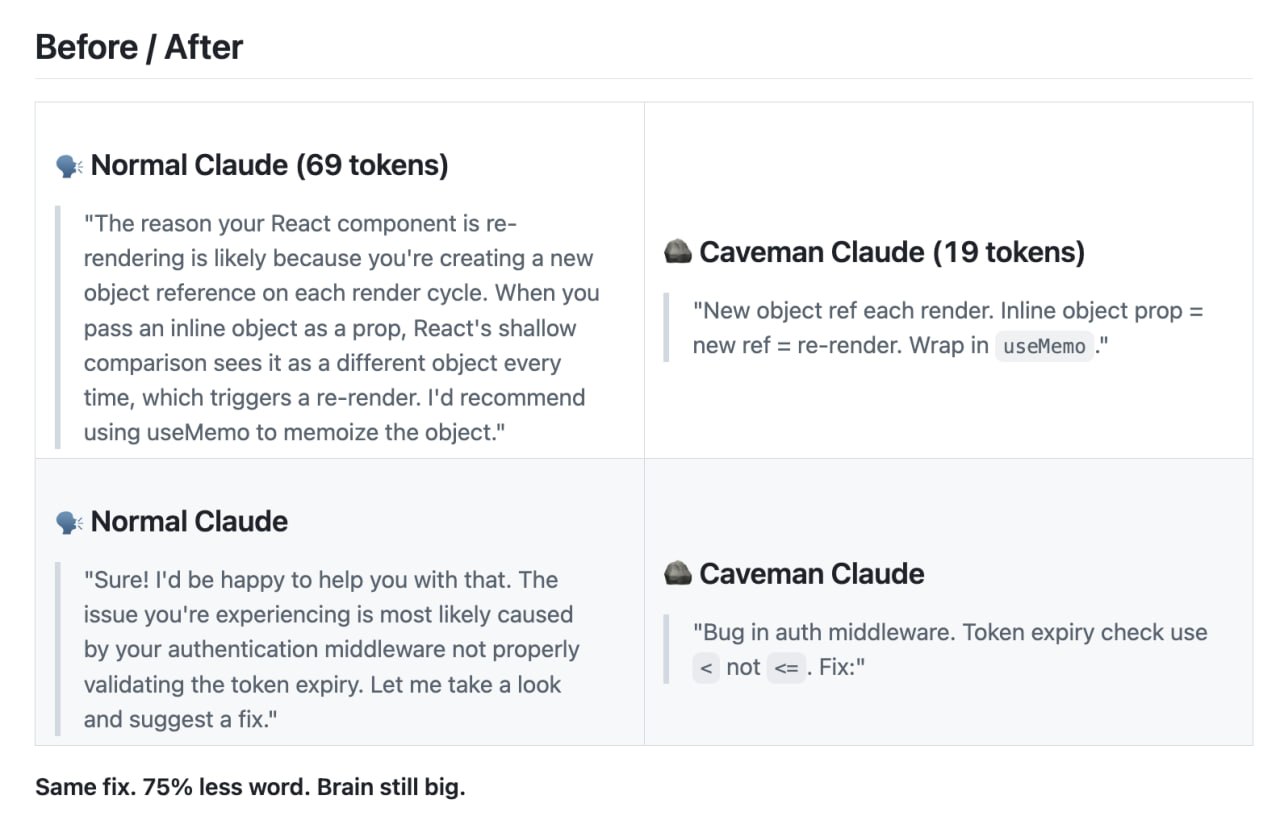

Команда разработчиков JuliusBrussee представила инновационный метод оптимизации работы больших языковых моделей, который позволяет существенно сократить расход вычислительных ресурсов. Суть метода заключается в переобучении нейросетей, таких как Claude и Codex, на использование упрощенной лексики, напоминающей речь древних людей. Вместо стандартных фраз вроде «я запустил инструмент веб-поиска», модель теперь использует короткие конструкции типа «инструмент работать» или «я делать». Такой подход позволяет удалять из ответов искусственного интеллекта все лишние слова, оставляя только технически важную информацию.

Механизм экономии ресурсов

Основной целью данной технологии является снижение количества потребляемых токенов при генерации текста. Исследования показывают, что использование минималистичного стиля общения позволяет сократить объем данных на в среднем на 65%. Это означает, что для выполнения той же задачи — например, поиска информации или написания кода — серверу требуется значительно меньше времени и энергии. В контексте масштабных вычислений это приводит к прямой экономии финансовых затрат на обслуживание дата-центров.

Практическое применение метода

Технология особенно актуальна для разработчиков, работающих с API крупных языковых моделей, где лимиты на количество токенов могут стать узким местом. Переобучение модели на «пещерный язык» не снижает качество выполнения задач, а лишь меняет формат обратной связи. Система продолжает понимать сложные запросы и выдавать точные результаты, но делает это более лаконично. Это открывает возможности для обработки больших объемов данных в реальном времени без перегрузки инфраструктуры.

Где получить инструмент

Для реализации данной оптимизации разработчики опубликовали открытый исходный код проекта caveman на платформе GitHub. Проект доступен по ссылке https://github.com/JuliusBrussee/caveman. В репозитории содержится инструкция по настройке модели и примеры использования. Интеграция такого подхода в существующие системы может стать важным шагом к повышению энергоэффективности искусственного интеллекта в будущем.

Внедрение подобных методов обработки данных свидетельствует о том, что развитие ИИ идет не только в сторону усложнения моделей, но и в сторону их рационализации. Экономия ресурсов становится ключевым фактором устойчивого развития технологий. Использование упрощенных языковых конструкций позволяет сделать искусственный интеллект более доступным и экологически безопасным, что соответствует глобальным трендам в области цифровой трансформации.