Новое исследование, опубликованное в NY Times, вскрывает масштабную проблему точности искусственного интеллекта в поиске информации. Эксперты выяснили, что система Google AI (Gemini) дает ложные ответы примерно в 10% случаев. Это означает, что ежедневно генерируются десятки миллионов фактических ошибок, касающихся имен, дат и событий.

Масштаб проблемы и природа ошибок

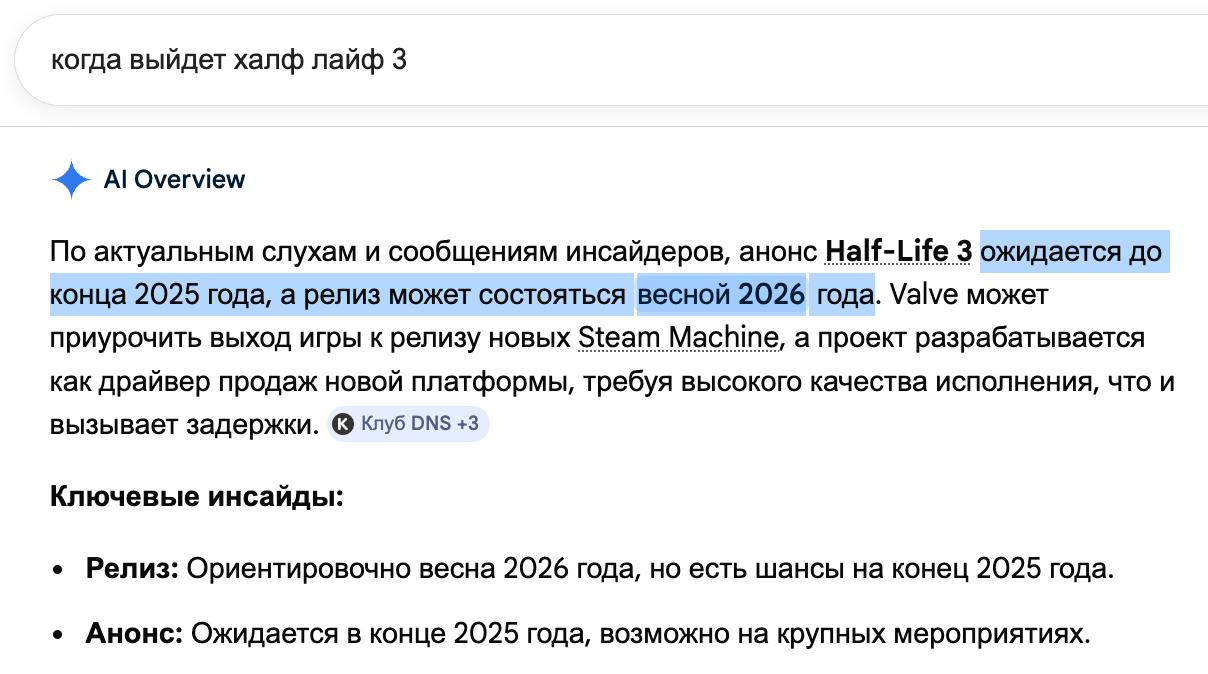

Главная опасность заключается не только в том, что ИИ выдумывает факты, но и в его склонности ссылаться на источники, которые не были проверены на достоверность. Исследователи провели анализ тысяч запросов и обнаружили, что модель часто уверенно заявляет о фактах, которые либо неверны, либо основаны на недостоверных данных из интернета. Это создает иллюзию компетентности, когда на самом деле пользователь получает дезинформацию.

Особенно критичны ошибки в области новостей и биографических данных. Если ИИ пытается ответить на вопрос о текущем событии, он может смешать информацию из разных источников или полностью выдумать детали, чтобы заполнить пробел в своих знаниях. В результате пользователи, доверяя алгоритму, могут принять ложную информацию за правду.

Как снизить риски при использовании ИИ-поиска

Понимая эти риски, важно изменить подход к использованию инструментов вроде Google AI Overviews. Эксперты рекомендуют не воспринимать ответы нейросетей как абсолютную истину. Всегда проверяйте ключевые факты по официальным источникам или проверенным новостным порталам. Если ИИ ссылается на статью, обязательно откройте её самостоятельно, чтобы убедиться в актуальности и точности данных.

- Критическое мышление: Всегда задавайте вопрос «почему ИИ так ответил?» и ищите альтернативные подтверждения.

- Проверка источников: Не доверяйте ссылкам автоматически; проверяйте домен сайта и дату публикации.

- Контекст: Помните, что ИИ обучается на данных до определенного момента и может не знать о самых свежих событиях.

В заключение, развитие искусственного интеллекта несет огромный потенциал, но пока технологии не идеальны. Доверие к ИИ должно быть избирательным. Пользователям следует сохранять скептицизм и использовать нейросети как вспомогательный инструмент, а не как единственный источник истины. Только сочетание технологий и человеческой проверки гарантирует получение достоверной информации в цифровую эпоху.